Tag: SEO

Mitte der 1990er Jahre fingen die aller ersten Suchmaschinen an, das frühe Web zu katalogisieren. Die Seitenbesitzer erkannten schnell den Wert einer bevorzugten Positionierung in den Suchergebnissen und recht bald fand man Behörde, die sich auf die Besserung professionellen.

In Anfängen ereignete sich der Antritt oft über die Transfer der URL der speziellen Seite an die vielfältigen Suchmaschinen im WWW. Diese sendeten dann einen Webcrawler zur Analyse der Seite aus und indexierten sie.[1] Der Webcrawler lud die Internetseite auf den Server der Search Engine, wo ein weiteres Angebot, der gern genutzte Indexer, Informationen herauslas und katalogisierte (genannte Ansprüche, Links zu sonstigen Seiten).

Die zeitigen Varianten der Suchalgorithmen basierten auf Angaben, die durch die Webmaster auch vorhanden wurden von empirica, wie Meta-Elemente, oder durch Indexdateien in Internet Suchmaschinen wie ALIWEB. Meta-Elemente geben eine Gesamtübersicht via Inhalt einer Seite, gewiss setzte sich bald hoch, dass die Anwendung dieser Ratschläge nicht gewissenhaft war, da die Wahl der gebrauchten Schlagworte dank dem Webmaster eine ungenaue Darstellung des Seiteninhalts spiegeln kann. Ungenaue und unvollständige Daten in den Meta-Elementen konnten so irrelevante Internetseiten bei besonderen Suchen listen.[2] Auch versuchten Seitenersteller unterschiedliche Eigenschaften im Laufe des HTML-Codes einer Seite so zu manipulieren, dass die Seite überlegen in den Suchergebnissen gelistet wird.[3]

Da die neuzeitlichen Internet Suchmaschinen sehr auf Gesichtspunkte angewiesen waren, die bloß in Fingern der Webmaster lagen, waren sie auch sehr unsicher für Missbrauch und Manipulationen im Ranking. Um gehobenere und relevantere Vergleichsergebnisse in Suchergebnissen zu bekommen, mussten sich die Anbieter der Suchmaschinen im Netz an diese Gegebenheiten anpassen. Weil der Gelingen einer Suchseite davon abhängt, besondere Suchergebnisse zu den gestellten Keywords anzuzeigen, vermochten unpassende Testergebnisse darin resultieren, dass sich die Benutzer nach sonstigen Optionen wofür Suche im Web umsehen. Die Auflösung der Suchmaschinen inventar in komplexeren Algorithmen beim Rangordnung, die Punkte beinhalteten, die von Webmastern nicht oder nur nicht leicht kontrollierbar waren. Larry Page und Sergey Brin konstruierten mit „Backrub“ – dem Stammvater von Google – eine Suchmaschine, die auf einem mathematischen KI basierte, der mit Hilfe der Verlinkungsstruktur Seiten gewichtete und dies in Rankingalgorithmus einfluss besitzen ließ. Auch andere Suchmaschinen im Netz orientiert während der Folgezeit die Verlinkungsstruktur bspw. in Form der Linkpopularität in ihre Algorithmen mit ein.

Suchmaschinen

Nachricht: Danny Seo Teaches You Tips on how to Make the Perfect Reward Out of Wine Corks | Do Simply One Factor

How To: On-page search engine optimization Tutorial – Rank Any Web site or Blog on 1st Page of Google in 2020 | Pritam Nagrale

How To: Tips on how to Make the search engine optimisation Case to Small Companies – Whiteboard Friday

Mehr zu: Danny Search engine optimization Teaches Drew The right way to Make Scrumptious No-Bake Vegan Cheesecake

Mitteilung: Find out how to search engine optimization eBay Product Title for enhance gross sales? Full tutorial – create unique Product Title | 2021

Off Web page website positioning Tutorial for Inexperienced persons | Off Page search engine optimisation Full Course in Hindi | Off Web page SEO Kaise Kare

![How To Rank No. 1 On youtube | {Learn|Study|Be taught} Youtube {SEO|search engine optimization|web optimization|search engine marketing|search engine optimisation|website positioning} Step by Step Tutorial [SEO] How To Rank No. 1 On youtube | {Learn|Study|Be taught} Youtube {SEO|search engine optimization|web optimization|search engine marketing|search engine optimisation|website positioning} Step by Step Tutorial [SEO]](/wp-content/uploads/2022/06/1654246279_maxresdefault.jpg)

How To Rank No. 1 On youtube | Study Youtube web optimization Step by Step Tutorial [SEO]

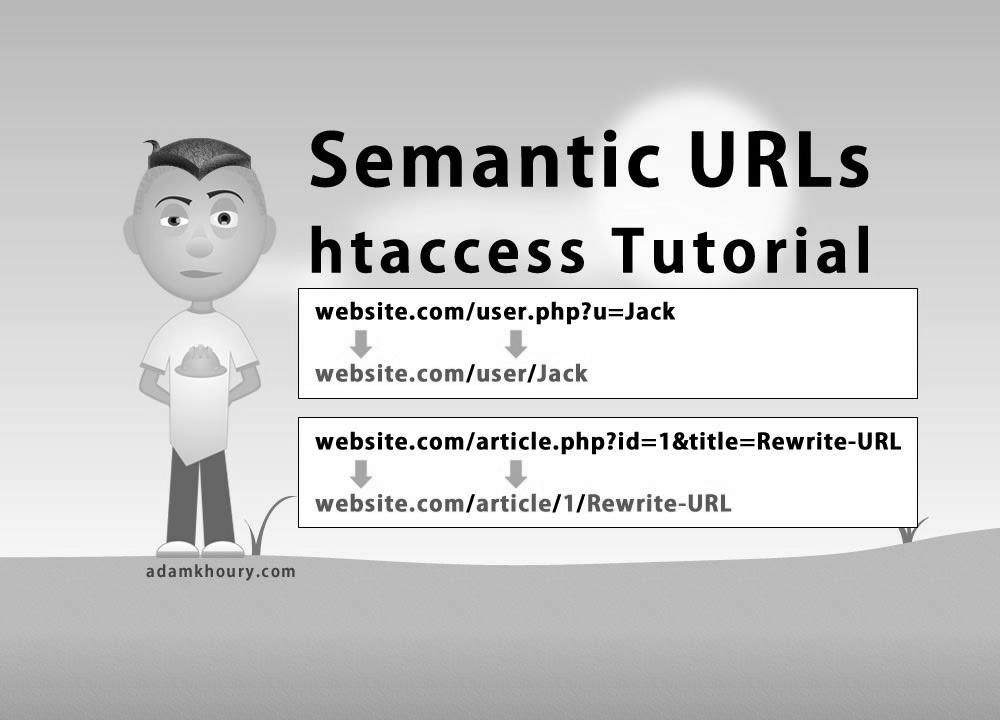

Semantic URL htaccess Tutorial Search engine optimisation Friendly Clear Hyperlinks Rewrite

Managing Property and search engine marketing – Study Subsequent.js